Мир, в котором можно верить своим глазам, быстро уходит в прошлое. По крайней мере, когда эти глаза смотрят в экран смартфона. В 2026 году лицо, голос и даже манера человека моргать и дышать могут стать ключом к банковским счетам, а мошенники примеряют маски голливудских звезд и мировых лидеров так же легко, как фильтры в соцсетях.

В этой статье корреспондент редакции вместе с экспертами разбирается, как безобидная игра с нейросетями превратилась в эффективное оружие киберпреступников, где проходит граница между цифровым творчеством и уголовной ответственностью и, главное, как обычному казахстанцу защититься от новых ИИ-угроз. А чтобы показать, как просто это работает сегодня, редакция попросила специалистов сгенерировать для читателей поддельное видео со звездой.

Как начинались дипфейки

Всё началось с безобидных фильтров в социальных сетях и "омоложения" актёров в голливудских блокбастерах. Но к 2026 году технологии, доступные ранее только киностудиям, поселились в каждом смартфоне. Сегодня грань между реальной видеосъёмкой и программным кодом стёрлась настолько, что верить экрану становится опасно.

Первым звоночком для казахстанцев стали вирусные ролики в соцсетях, где мировые знаменитости вдруг заговаривали на казахском или признавались в любви к местным достопримечательностям. Пока пользователи соцсетей умилялись новым трендам, за фасадом забавных видео формировался чёрный рынок: технологии быстро взяли на вооружение те, кто понял, что чужое лицо может стать эффективным инструментом для взлома кошелька, — создатели мошеннических дипфейков.

И совсем скоро уже казахстанские "звёзды" стали рассказывать на видео о "фантастических способах получения прибыли".

А затем технологии упростились и удешевились настолько, что стало доступным создание индивидуальных дипфейков под любого обычного казахстанца. Как в истории с жительницей Костаная, у которой финансовой помощи попросил "сам Киану Ривз".

Чтобы понять, как противостоять этой угрозе, нужно разобраться в самом механизме обмана.

Как ИИ-мошенничество работает в 2026 году

Специальный алгоритм (нейросеть) изучает реальные изображения, видео или записи голоса конкретного человека. Он фиксирует и "запоминает" всё: как двигаются мышцы лица, как человек щурится, с какой интонацией произносит специфические звуки. Затем нейросеть "накладывает" лицо или голос одного человека на действия другого.

В 2026 году дипфейки делятся на три основных типа:

- Face Swap (замена лица): лицо известной персоны накладывается на тело другого человека — нередко нанятого актёра. Именно так "Брэд Питт" гуляет по набережной Семея.

- Voice Cloning (клонирование голоса): ИИ достаточно всего 3–5 секунд записи вашего голоса, чтобы он мог прочитать любой текст вашим тембром. Это главный инструмент мошенников в WhatsApp.

- Real-time Deepfake (дипфейк в реальном времени): самая коварная технология, позволяющая подменять внешность прямо во время видеозвонка в Zoom или Telegram.

В чём главная опасность?

Раньше для создания подобного эффекта требовались недели работы профессиональной киностудии. Сегодня создать "цифрового двойника" можно за 30 минут с помощью обычного смартфона и приложения стоимостью в пару долларов. В эпоху дипфейков фраза "я видел это своими глазами" больше не является гарантией правды.

Ограбление на 25 миллионов долларов — самый "дорогой" случай

На данный момент самая масштабная и технически совершенная атака случилась в Гонконге в 2024 году. История выглядит как кошмарный сон финансового работника, но произошла она в реальности.

Под ударом оказался гонконгский филиал компании Arup Group, это британский гигант в сфере проектирования и инженерного дизайна с мировым именем. Именно эта компания работала над такими легендарными проектами, как Сиднейский оперный театр и Центр Помпиду в Париже.

Сотрудник их финансового отдела получает письмо от "финансового директора" из Лондона с просьбой о секретной транзакции. Сумма крупная, поэтому в какой-то момент менеджер начинает сомневаться, но мошенники приглашают его "для подтверждения" на групповой видеозвонок в Zoom.

Потом пострадавший свидетельствовал, что все его липовые коллеги "выглядели и говорили как настоящие".

Этот случай показывает, что жертвой дипфейка в современном мире может стать даже сотрудник высокотехнологичной международной корпорации, а не только "доверчивая бабушка".

Казахстанские кейсы дипфейк-мошенничества

Если после истории об ограблении в Гонконге кажется, что это сюжеты из "жизни мировых корпораций", то есть информация, которая может расстроить: мошенническая ИИ-реальность уже давно живёт в казахстанских городах.

Её мишенями становятся обычные граждане: сталкиваются с "ожившими" кумирами в WhatsApp, получают видеосообщения от "министров МВД" и "ходят на свидания" с голливудскими звёздами, не покидая своего дома в Костанае.

Инвестиционная платформа-фейк с Димашем Кудайбергеном

Одной из самых масштабных ИИ-атак в казахстанском сегменте интернета стала фейковая рекламная кампания "крупного инвестиционного проекта" от лица компании "Казатомпром". Мошенники решили бить по самому святому — национальному кумиру, выбрав "лицом" платформы Димаша Кудайбергена.

Ролик набрал несколько миллионов просмотров, обещая казахстанцам невероятные доходы от добычи урана. Но самым коварным ходом стало использование в рекламе не только самого артиста, но и его родителей.

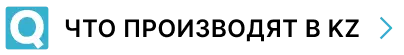

Стоп-кадры из фейкового видео (слева — Димаш Кудайберген, справа — его родители)

Стоп-кадры из фейкового видео (слева — Димаш Кудайберген, справа — его родители)

Как было сделано фейковое видео с Димашем и его родителями

Для создания дипфейка преступникам даже не пришлось ничего снимать. Они использовали метод "репозиционирования" существующего контента. Для первой части ролика было взято общедоступное новогоднее поздравление из Instagram-аккаунта Димаша:

Посмотреть эту публикацию в Instagram

Материал для той части ролика, в которой о проекте "рассказывают" родители Димаша, мошенники также скопировали из Instagram-поста. Оригинальное видео было записано семьёй Кудайберген как тёплое поздравление казахстанцев с Наурызом.

Стоп-кадры для сравнения: слева — кадр из фейкового видео, справа — скриншот настоящего поста супругов Кудайберген в Instagram

Стоп-кадры для сравнения: слева — кадр из фейкового видео, справа — скриншот настоящего поста супругов Кудайберген в Instagram

С помощью нейросетей мошенники наложили на видео новый звук и синхронизировали движение губ (так называемый липсинк) — чтобы добрые пожелания превратились в призыв вкладывать деньги в сомнительную платформу.

Этот случай стал хрестоматийным примером того, как личный контент любого человека может быть украден и перепрошит искусственным интеллектом для совершения преступления.

"Хотела помочь Киану Ривзу": казахстанку пыталась обмануть "звезда Голливуда"

Если от имени Димаша казахстанцам продавали идею "разбогатеть" через инвестиции, то в следующем случае мошенники торговали мечтой о близости с кумиром. В 2024 году 62-летняя жительница Костаная столкнулась с классической схемой романтического мошенничества. Всё началось с лайка под её постом в соцсетях — он был от аккаунта, который полностью имитировал профиль голливудской звезды Киану Ривза.

Спустя время "Киану" сообщил о серьёзных проблемах: якобы из-за судебных тяжб его счета заморожены, а ему срочно нужны деньги на медицинские расходы. Женщина, искренне желая помочь кумиру, уже была готова перевести крупную сумму.

Этого не произошло только благодаря бдительности банковских сотрудников: они заметили, что счёт, куда жительница Костаная собиралась отправить деньги, принадлежал неизвестной игровой компании, и передали информацию в полицию.

Этот случай не исключение, а глобальный тренд.

Похожая история с "Брэдом Питтом" в Европе закончилась куда трагичнее: 53-летняя француженка не только перевела мошенникам 830 000 евро, но и разрушила свою реальную семью ради иллюзии, созданной алгоритмами.

Цифровой клон: как мошенники "украли" бренд Tengrinews.kz

Наше издание тоже не раз оказывалось в центре киберпреступных схем. Мошенники поняли: люди не верят анонимным ссылкам, но безоговорочно доверяют логотипу, который видят в своей ленте ежедневно.

Поэтому стали создавать рекламные аккаунты, которые визуально неотличимы от официальных страниц Tengrinews.kz. Использовали всё: фирменные цвета, шрифты, логотип, даже фото и имена реальных журналистов нашего издания.

Затем запускали таргетированную рекламу о "розыгрышах призов", "социальных выплатах" или "компенсациях за НДС". Чтобы усилить эффект правдоподобности, преступники использовали дипфейк-видео, где ИИ-копии известных ведущих новостей "официально" объявляли о начале выплат.

Скриншот сайта мошенников, который имитировал Tengrinews.kz

Скриншот сайта мошенников, который имитировал Tengrinews.kz

Клик по ссылке вёл на сайт-двойник, который выглядит как страница банка или госоргана. Итог предсказуем: там пользователя просят ввести ИИН, номер карты и — внимание — CVV-код. С этого момента контроль над счётом переходит к преступникам.

Как не попасться на удочку лжеизданий?

В какой-то момент наша редакция была вынуждена выпустить специальное предупреждение для читателей:

Мошенничество в соцсетях: Tengrinews.kz предупреждает о поддельных постах

Нужно запомнить: в цифровом мире верить нельзя даже знакомой "шапке" сайта. Всегда нужно проверять два параметра:

- адресную строку (она должна быть только tengrinews.kz, без лишних символов и тире);

- наличие "синей галочки" верификации в соцсетях.

Взгляд изнутри: как создаются цифровые иллюзии и почему мы в них верим?

В основе историй о "Киану Ривзе", с которым общалась жительница Костаная, или миллионных хищениях в Гонконге — работа алгоритмов, помноженная на знание человеческой психологии.

Чтобы понять, насколько глубоко нейросети проникли в нашу повседневность и есть ли у нас шанс отличить правду от генерации, мы обратились к тем, кто знает эту сферу изнутри на профессиональном уровне.

Наши эксперты — от ИИ-художников до компьютерных криминалистов — объясняют, как создаются современные дипфейки, почему мошенники стали профессиональными психологами и что делать, когда "собственные глаза" начинают обманывать.

"В ближайшее время даже специалисты не отличат работу нейронок от реальности"

Риз Есентаев — нейродизайнер, работающий над созданием изображений и видео при помощи нейросетей. Он отмечает, что инструменты, которыми сейчас создаются дипфейки, широко используются в ИИ-продакшене. И рассказывает, что есть несколько разных способов использовать чужую внешность:

- взять готовое видео и заменить лицо на другое;

- изменить своё лицо в прямом эфире (включается веб-камера, и нейронке даётся референс с персонажем);

- сгенерировать видео полностью с помощью ИИ.

"И если говорить о мошеннических действиях — здесь для преступников огромное поле возможностей".

— Могут ли сейчас специалисты со стопроцентной уверенностью выявить дипфейк? — уточняем мы у нейродизайнера Есентаева.

— Зависит от того, какую технологию использовать. Да, уже есть технологии, в которых отличия сложно увидеть даже специалисту. — отвечает он. — А при скорости развития ИИ-технологий в ближайшее время и специалистам практически невозможно будет различать работу нейронки и реальные съёмки.

— Как обычному человеку, неспециалисту, отличить фейковое видео?

— Нужно внимательно вглядываться в лицо на предмет артефактов: это размытые края, разная текстура и чёткость лица и остального тела; проблемы с анимацией, неестественные движения, ну и основное — это липсинк, то есть движение губ.

Чаще всего нейронку можно вычислить именно по губам, потому что при разговоре это достаточно активные движения и не всегда они идеально синхронизируются со звуком.

— У этой технологии две стороны, — отмечает эксперт. — С одной — огромные риски: мошенничество, фейковые новости, политические манипуляции. Уже сейчас можно сделать видео, где президент или известный блогер говорит что угодно, и 90 процентов людей это проглотят.

С другой стороны, это невероятный творческий инструмент. Мы в продакшене теперь за пару дней делаем то, что раньше снималось месяцами и стоило миллионы. Актёра можно "омолодить", создать персонажа, которого в реальности не существует, или снять рекламу с лицом бренд-амбассадора, даже если он физически находится на другом континенте.

Поэтому я считаю, что запрещать или сильно ограничивать технологию бессмысленно — она всё равно будет развиваться. Важнее научиться жить в мире, где видео больше не является стопроцентным доказательством.

"Майкл Джексон" обращается к читателям Tengrinews

Лучший способ понять, насколько далеко зашли технологии, — увидеть их в действии. Прямо сейчас "король поп-музыки Майкл Джексон" в двух видео ниже обращается к читателям Tengrinews.kz с актуальным для статьи призывом:

Этот ролик — стопроцентный дипфейк, созданный специально для нашей редакции нейродизайнером Ризом Есентаевым.

Как это было сделано?

"Создание такого ролика состоит из четырёх этапов: генерация изображения, анимация, генерация озвучки и липсинк. На всё ушло около 30–40 минут", — делится эксперт.

Звезда TikTok продала своё "лицо" почти за миллиард долларов

Фабрика имитаций: когда интернет наполовину состоит из ботов

Чтобы понять, как мошенники автоматизируют обман и почему собеседник в комментариях может оказаться строчкой программного кода, мы обратились к Елхану Оралбаеву, эксперту, который называет себя бот-мейкером.

Елхан создаёт ботов, "живущих" в соцсетях и мессенджерах, для общения с клиентами и автоматизации рутинных процессов.

Он уверен: мы уже живём в "мёртвом интернете", где отличить живую реакцию от сгенерированной становится почти невозможно.

— Елхан, правда ли, что под любым постом в соцсетях сейчас возможна массовая атака ботов и мы иногда читаем ответы не людей, а искусственного интеллекта?

— Однозначно. По разным данным, сегодня уже 50 процентов, а то и больше комментариев в интернете — от ботов. Современный ИИ-бот умеет сам искать информацию по заданным триггерам, анализировать контекст и комментировать пост в соответствии с промтом (заданием), который в него прописали. Это происходит в автоматическом режиме 24/7. Боты не устают, не спят и могут имитировать любую эмоцию — от восторга до яростного спора.

— Какие сценарии использования ИИ сейчас наиболее опасны для обычных пользователей?

— Главное — это эволюция классических схем. Если раньше мошенники звонили искажённым голосом, имитируя "внучку, попавшую в аварию", то теперь они используют реальный голос вашего близкого. ИИ может записать даже видеокружок в Telegram с нужным лицом.

В сочетании с технологией спуфинга (подмены номера), когда на экране вашего телефона высвечивается реальный контакт из вашей телефонной книги, такая атака становится фатальной. Но здесь есть простая защита: если вам звонят через сотовую связь от имени родственника, сразу сбрасывайте и перезванивайте сами. Только при обратном звонке вы гарантированно попадёте к реальному человеку, а не на сервер мошенников.

— Мы привыкли, что взлом — это сложный технический процесс. ИИ упростил жизнь хакерам?

— ИИ создаёт вредоносное ПО в разы быстрее человека, но "взломать" человека всё ещё проще, чем систему. Сейчас процветает фишинг через взломанные аккаунты друзей. Вам присылают ссылку в личку: "проголосуй за фото", "посмотри видео со мной". Предлоги могут быть любыми.

Рекомендация эксперта: если ссылка не ведёт на популярные сервисы (YouTube, Instagram, TikTok), а требует какой-то авторизации или голосования — не переходите. Свяжитесь с отправителем через другой мессенджер. То же самое касается и внезапных просьб одолжить денег.

— Говорят, что ИИ позволяет мошенникам применять "индивидуальный подход". Как это работает?

— Это высший пилотаж. Существуют боты, которые собирают о вас или вашей организации всю открытую информацию: соцсети, интервью, старые посты. ИИ резюмирует эти данные и составляет персонализированное сообщение. В легальном бизнесе это помогает продавать товары, но в руках мошенников это превращается в идеальный фишинг. Письмо или сообщение будет составлено так, что именно вы, зная контекст, с большой вероятностью его откроете и поверите написанному.

"Глупых среди жертв нет"

Мы увидели, как создаются дипфейки и как боты заполняют наше пространство. Но главный вопрос: почему, даже зная о существовании этих технологий, мы продолжаем попадаться на крючок?

Чтобы разобраться в "анатомии" киберпреступления и понять, как выглядит современный "цифровой вор", мы поговорили с Анатолием Ремнёвым, экспертом-форензиком и специалистом в области компьютерной криминалистики.

Его работа — искать цифровые следы там, где преступник пытается казаться невидимым. А его опыт заставляет пересмотреть отношение к собственной безопасности.

Наш первый вопрос: если сравнивать с ситуацией 2–3 года назад, как изменился среднестатистический кибермошенник в Казахстане? Какие появились новые инструменты?

Ответ специалиста:

"Среднестатистический мошенник — слишком размытое определение. Мы должны понимать, что за каждой схемой мошенничества стоят не только конечные исполнители, но и организаторы. Именно они стали гораздо опытнее в области психологии пользователя, обывателя интернета, опытнее в методах обмана. Сама суть мошенничества не изменилась. Изменился её формат. Наше общество стало цифровым. Все негативные и деструктивные явления из нашей обыденной жизни плавно и гармонично, как бы странно это ни звучало, перетекли в цифровую экосистему".

Если говорить об инструментах — то это всё те же четыре основных метода социальной инженерии:

- претекстинг (пресловутые "службы безопасности" банков),

- фишинг (например, ссылки на "службы доставки" при онлайн-покупках на OLX),

- метод "услуга за услугу" ("техническая поддержка", звонки от "следователей"),

- и высший пилотаж — обратная социальная инженерия, когда жертва сама обращается за помощью к злоумышленникам.

В зависимости от предмета и области мошенничества выбирается тот или иной классический способ и уже адаптируется к конкретной схеме. Суть одна — войти в доверие пользователя и побудить его абсолютно добровольно расстаться с собственными сбережениями или имуществом.

Проблема в том, что мошенники с каждым днём повышают свою квалификацию в таких специфических областях, как, например, профайлинг.

— Назовите, пожалуйста, одну схему с использованием ИИ, которая наиболее распространена сейчас в Казахстане, но о которой большинство людей даже не подозревают.

— Не могу дать, к сожалению, точной оценки касательно степени распространённости, но, на мой взгляд, это схема с клонированием изображения и голоса популярных политиков, блогеров, публичных персон с рекламой высокодоходных вложений или несуществующих акций. Выглядит вполне естественно на общем, ставшем уже нам привычным, информационном шуме с рекламой всего чего угодно с привлечением артистов, актёров, лидеров общественных мнений в социальных сетях.

— Deepfake — это уже не просто подмена лица в видео. Какие самые изощрённые варианты использования синтеза голоса и изображения вы встречали в практике?

— Вы правы, deepfake давно вышел за рамки "приклеили лицо в видео". Самые продвинутые схемы — это уже комбинации видео и сценариев с интерактивным реагированием (поведенческим контекстом), где искусственный интеллект имитирует не только внешность, но и манеру общения. Преимущественно это реализуется через видеоконференции.

В личной практике приходилось исследовать запись такой видеоконференции с презентации одной из финансовых пирамид, когда с участниками общался и отвечал на их вопросы "основатель" компании. Также встречались сгенерированные пресловутые "кружочки" с видео на тему "мама, я попала в ДТП".

— Мы видим появление "синтетических личностей". Может ли дойти до того, что банки вообще откажутся от удалённой верификации личности из-за невозможности отличить ИИ от человека? Что тогда на замену?

— Думаю, что нет, сама процедура удалённой верификации останется. Но претерпит существенные изменения. Самый сложный вопрос здесь — в сборе биометрической информации (отпечатки пальцев, снимки сетчатки глаз) в качестве эталонной. Возможно, будет применена некоторая форма двухфакторной верификации с учётом развития технологий и разработки моделей подтверждения личности на основе совокупности технических факторов.

— Существуют ли в Казахстане программы, способные на 100 процентов отличить голос живого человека от синтезированного ИИ при телефонном звонке?

— Мне неизвестно о существовании такого программного обеспечения. И с технической точки зрения такой софт нереализуем по ряду причин. Качество синтеза речи уже на уровне "человек — человек": современные ИИ-модели воспроизводят дыхание, паузы, оговорки, имитируют эмоции, интонации, адаптируются под шум и "телефонное" качество звука.

При цифровой обработке сигналов в сетях связи многие артефакты (признаки ИИ) просто исчезают, и детектору банально не за что зацепиться. Да, существуют системы (у банков преимущественно), которые анализируют спектр, ритм речи, проверяют поведенческие признаки, но они основаны в большинстве случаев на сравнении с эталонными записями, и результат их работы вероятностный — оценка даётся в процентах.

Вопрос "Настоящий ли это голос?" больше не имеет точного и надёжного ответа. Правильный вопрос другой: "Как проверить личность, если голосу доверять нельзя?"

— Мошенники начали использовать нейросети для создания фишинговых писем и сайтов. Чем ИИ-фишинг отличается от старого? Что выдаёт подделку сейчас, когда грамматических ошибок больше нет?

— Да, визуально фишинговые инструменты стали неотличимы от прототипов. Но признаки их выявления остались, как ни странно, те же самые: похожие доменные имена с ошибкой в одном или двух символах, нестыковки в информации (неактуальный адрес, место работы), слишком общая формулировка.

Старой осталась и логика атаки — временной интервал подтверждения короткий. И психология — "блокировка", "начислен бонус", "время ограничено". Ну и классика жанра — запрос через онлайн-форму сведений, которые должны быть заведомо известны или избыточны для данного запроса: запрос ИИН, реквизиты банковской карты с CVV-кодом и так далее.

— Расскажите о деле, которое вы вели, где ИИ использовался наиболее неожиданно.

— Не столько вёл, сколько был консультантом. Цифровая личность девушки на сайте знакомств. Длительная переписка. Фото. Видео. В итоге просьба о финансовой помощи с вполне предсказуемым исходом.

— Что происходит на месте преступления, когда оно — цифровое? Как выглядит "выезд" специалиста по компьютерной криминалистике?

— Всё зависит от характера и обстоятельств. В любом случае, как и в классической криминалистике, это осмотр "места" преступления (телефон, компьютер, сервер), сбор доказательств (логи, файлы, дампы памяти). Преимущественно это происходит удалённо. Реже — с выездом на место расположения оборудования или в тот же мошеннический кол-центр для пресечения попыток удаления цифровых следов.

Но иногда бывают и исключения из правил: например, проведение исследования и сбора данных с фитнес-браслета непосредственно на теле с целью установления точного времени смерти и её обстоятельств по динамике показателей жизнедеятельности.

— Многие уверены: "меня не обманут, я же не глупый". Кто на самом деле чаще всего становится жертвой мошенничества с использованием ИИ?

— Давайте так: глупых среди жертв нет.

Попадаются даже компетентные люди в конкретный момент уязвимости, потому что прежде всего мошенники осуществляют сбор информации о потенциальной жертве, и чем полнее составлен её портрет, тем выше гарантия успеха.

Портрета, или, правильнее сказать, профиля типичной жертвы тоже нет. Есть повторяющиеся паттерны поведения на основе поведенческой психологии и ситуационной манипуляции.

- На первое место я бы поставил людей, безусловно доверяющих системе, — пенсионеры, люди, далёкие от правового и экономического поля. С ними наиболее эффективны схемы претекстинга (звонки из "банков", от "следователей", "налоговых инспекторов", "контролёров").

- На втором месте чаще всего люди в состоянии стресса, эмоциональной уязвимости (фрустрации) или спешки, рабочего цейтнота, когда нет времени на проверку, трезвую оценку ситуации, а решение принимается эмоционально.

- Третья категория риска — это социально активные пользователи, оставляющие в сети множество цифровых следов, формирующие сами на себя идеальное цифровое досье: с описанием жизненных событий, упоминанием друзей, коллег, указанием мест, периодичности их посещения, фотографии и другую информацию, которую в дальнейшем уже могут и используют в более сложных схемах. И вот здесь применение ИИ делает атаку практически идеальной.

— Как сказал бы типичный ИИ (тут криминалист смеётся): без иллюзий, без магии, защищает не опыт, не интеллект, защищает привычка к процедуре.

Дипфейк шутки ради

В заключение расскажем ещё об одной опасности дипфейков, но уже направленной против его создателей. В современном мире подделка, созданная даже не с криминальной целью, а ради хайпа в соцсетях, тоже может довести до суда.

Самым резонансным случаем в Центральной Азии стало дело блогера под псевдонимом Акума в Бишкеке в прошлом году. Девушка опубликовала в соцсетях изображения, созданные нейросетью, на которых она была запечатлена рядом с "президентом Кыргызстана Садыром Жапаровым".

Посмотреть эту публикацию в Instagram

Несмотря на то что изображения были явно сгенерированы ИИ, суд счёл их оскорбительными и порочащими достоинство главы государства. Блогер была признана виновной в распространении недостоверной информации и оштрафована.

Правда, пользователи соцсетей выразили тогда возмущение этим инцидентом:

"С другой стороны, вы видели сколько таких фотожаб с Трампом, Макроном, Меркель и прочими. Это развитые страны, но за такие вещи там не сажают и не штрафуют", — писали они.

Чтобы разобраться, грозит ли подобное казахстанцам, мы обратились к известному юристу Сергею Уткину.

— Общее правило в Казахстане (ст. 145 ГК РК) гласит: любое использование изображения человека возможно только с согласия этого лица или его наследников, — комментирует он.

— Какие существуют исключения, когда согласие спрашивать всё-таки не нужно?

— Исключения есть для журналистов, они прописаны в законе "О массмедиа" и "Об онлайн-платформах". Согласие не требуется, если:

- изображение взято из открытого аккаунта самого человека;

- лицо запечатлено на публичном мероприятии;

- вы сняли правонарушение;

- съёмка велась при исполнении лицом служебных обязанностей (врачи, полицейские).

Если используете чужие фото, необходимо помнить, что у них есть автор и может быть ещё правообладатель, поэтому вопрос соблюдения авторского права — это отдельная тема.

Теперь относительно дипфейков.

По сути, это распространение ложной информации, что запрещено законом и за что предусмотрена административная и даже уголовная ответственность. Но если дипфейк прямо обозначен, например, указано, что это коллаж с помощью ИИ либо сатирическое изображение и тому подобное — когда пользователям абсолютно понятно, что их не вводят в заблуждение, что это не реальное фото или видео, то ответственность за распространение ложной информации наступать не должна.

Так что в подобных случаях, в том числе с использованием ИИ, необходимо руководствоваться общими вышеуказанными правилами и исключениями и не распространять ложную информацию.

Инструкция: как не стать жертвой кибермошенников

Главный вывод из бесед с экспертами звучит отрезвляюще: глаза и уши больше не являются надёжными свидетелями. Если на экране смартфона вы видите лицо мамы или слышите голос начальника — это лишь набор пикселей и частот, которые могут быть подделаны за 30 минут.

Чтобы защитить себя, нужно сменить роль "жертвы" на роль "активной стороны". Вот пошаговый алгоритм:

1. Правило "встречного боя": перехватывайте инициативу

Если вам звонят (в мессенджере или по телефону) и просят денег, пугают ДТП или предлагают "секретные инвестиции":

- Сбросьте звонок. Не пытайтесь разоблачить мошенника в разговоре — нередко на таких позициях работают профессиональные психологи (профайлеры).

- Перезвоните сами. Но не по тому же каналу! Если звонили в WhatsApp — наберите обычный сотовый номер. Если звонили с сотового — напишите в Telegram.

- Личный пароль. Договоритесь с близкими о "кодовом слове" (девичья фамилия прабабушки, кличка первой собаки). Ни один ИИ не узнает этот пароль, если его нет в соцсетях.

2. Блокировка "цифрового цейтнота"

Мошенники всегда создают дефицит времени ("нужно сейчас!", "счёт заблокируют через пять минут").

Возьмите паузу в 10 минут. Просто положите трубку и выпейте воды. За это время эмоциональный фон спадёт, и вы сможете оценить ситуацию трезво.

3. Гигиена ссылок и "цифровых следов"

- Не "кормите" нейросети. Чем меньше ваших качественных фото и записей голоса в открытом доступе, тем сложнее создать ваш идеальный клон.

- Проверяйте "на ощупь". Помните совет нейродизайнера: ищите артефакты. Неестественная мимика, размытые края волос, странный липсинк (голос обгоняет губы). Если видео кажется "слишком идеальным" или, наоборот, слегка "плывёт" — это подделка. Если разговор идёт в реальном режиме, попросите собеседника помахать руками перед лицом и повернуть голову в разные стороны — на некоторых технологиях (но не на всех) это пока срабатывает.

4. Параноидальный фильтр для СМИ и брендов

Видите новость о выплатах на странице Tengrinews.kz — проверьте адрес в браузере. Если там написано tengri-news.com или tengrinews.kz.web.ru — это фишинг. Настоящий адрес только один: tengrinews.kz.

"Не верь глазам своим". Заключение

В прошлом веке был популярен афоризм Козьмы Пруткова, звучавший как призыв к критическому мышлению:

"Если на клетке слона прочтёшь надпись "буйвол" — не верь глазам своим".

В 2026 году эта фраза больше не работает. Вид слона в клетке под табличкой "слон" уже не гарантирует, что перед вами действительно слон. Кстати, по иронии судьбы со временем выяснилось, что и сам Козьма Прутков — вымышленный персонаж: под этим псевдонимом скрывалась группа литераторов.

Видео и фотографии больше не являются доказательством правды — теперь это скорее "игровое поле" и сфера искусства. И это тревожит: становится неясно, на что вообще можно опираться как на факт.

Придётся ли в будущем проходить многоступенчатую верификацию для любого действия? Появится ли Министерство правды? Или мы, как и в прошлые века, будем доверять только живым свидетелям?

Хотя и это не предел: следующий этап — возможно, мошеннические голограммы. Тогда для уверенности нужно будет не только видеть, но и прикасаться. По крайней мере, до тех пор, пока не появятся тактильные дипфейки. Хочется верить, что это не самое ближайшее будущее.

А пока остаются простые правила:

- быть внимательными,

- перепроверять информацию

- и помнить: если вам звонит Брэд Питт — скорее всего, ему нужна не ваша любовь, а ваш CVV-код.

Читайте также:

Жёны-куклы, новые отцы и "бостонские браки". Почему казахстанцы пересматривают идею семьи

Цифровой трибунал: как один пост в соцсетях наказывает виновных и рушит бизнес

Апатия, тревога, одиночество: что происходит с казахстанской молодёжью

"Бриллианты и котики": новое лицо наркомании в Казахстане