При этом, как показывают исследования, с каждым годом таких противоправных материалов становится всё больше, а помогает в этом искусственный интеллект. Редакция Tengrinews.kz разбиралась, как злоумышленники используют самую массовую и прогрессивную технологию в мире для создания контента с насилием над детьми.

Четыре года? Добро пожаловать в интернет

Казахстан — страна с одним из самых высоких уровней интернет-проникновения в Центральной Азии. Около 90 процентов взрослого населения имеет доступ к сети. Тарифы на интернет недорогие, инфраструктура развитая, электронное правительство работает. Всё это звучит как успех цифровизации — и во многом им является. Но у медали есть обратная сторона, о которой нечасто говорят.

Дети в Казахстане начинают пользоваться интернетом очень рано. По данным исследования ЮНИСЕФ "Kazakhstan Kids Online" (и делалось оно ещё в 2023 году), 46 процентов впервые "выходят в сеть" в возрасте от пяти до восьми лет, ещё треть — в девять-двенадцать. То есть к тому моменту, как ребёнок идёт в среднюю школу, он уже провёл онлайн несколько лет.

Также исследователи отмечают, что 92 процента опрошенных детей используют смартфон для выхода в интернет ежедневно, зачастую — по несколько раз в день. Больше половины тратят два и более часа в будний день на игры (51 процент) или общение с друзьями (57 процентов).

Это рост более чем на 20 процентов всего за несколько лет — с 2018-го. А ещё 31 процент детей тратит больше двух часов в день только на поиск информации.

"По данным ЮНИСЕФ, 33 процента населения Казахстана — это дети (6,7 миллиона человек — прим. редакции), и больше половины из них имеют высокую активность в сети. При этом сейчас снижается возраст первого выхода в интернет: если раньше это были дети восьми-девяти лет, то сейчас — уже четыре-пять лет, по сути дошкольники", — отмечает основательница НПО "TechnoWomen" Азиза Шужеева.

Выходит, что ежедневно более 3,3 миллиона детей в Казахстане активно потребляют самый разнообразный контент, общаются с другими людьми, ведут профили в соцсетях и регистрируются на различных онлайн-платформах, которые формально должны быть для них закрыты.

"Формально" — ключевое слово.

Большинство крупных платформ запрещает регистрацию до 13 лет. Но в Казахстане, по данным того же исследования, 60 процентов детей в возрасте девяти-десяти лет и 66 процентов одиннадцати-двенадцати лет уже имеют собственные аккаунты в соцсетях.

Причём большинство профилей полностью открыты — их может просматривать любой желающий. Дети младшего возраста чаще оставляют аккаунты публичными, чем подростки — просто потому что ещё не понимают, что это значит.

Реальные интернет-угрозы для детей: кибербуллинг и нежелательный контент

Интернет для казахстанских детей — это прежде всего соцсети и платформы с развлекательным контентом, вроде TikTok, Instagram или YouTube и мессенджеры для общения с друзьями и родителями.

По данным исследователей, 94 процента из опрошенных детей убеждены, что в интернете много полезных вещей для их возраста — и это правда. Но там же есть и всё остальное, гораздо менее полезное.

Вредоносный контент — это не абстракция, а то, с чем в интернете сталкиваются регулярно. Например, ЮНИСЕФ представил в своём отчёте такие данные:

Отдельная и очень серьёзная тема — сексуализированный контент. Исследователи отмечают, что каждый пятый опрошенный ребёнок хотя бы раз за год видел его в сети, а семь процентов — на регулярной основе.

Под этим имеется в виду следующее:

- 4,5 процента детей сталкивались в интернете с просьбами поговорить о сексе;

- три процента — с сексуализированными комментариями;

- три процента получали запросы скинуть свои интимные фото;

- трём процентам детей предлагали деньги или подарки в обмен на интимные фото;

- ещё двум процентам — за личную встречу с явным сексуализированным подтекстом;

- два процента детей подвергались шантажу с целью принуждения к сексуализированным действиям онлайн.

А когда всё же говорили о произошедшем, то в первую очередь с друзьями (32 процента), а не с родителями (24 процента).

О сексуализированном насилии в сети взрослым сообщал лишь каждый десятый ребёнок, а многие маленькие респонденты просто отказывались отвечать исследователям на вопросы о таком опыте, даже при гарантиях конфиденциальности.

ЮНИСЕФ отмечает, что происходит это из-за того, что родители в Казахстане системно недооценивают интернет-угрозы. Большинство опрошенных взрослых считают маловероятным, что их ребёнок столкнётся с чем-то тревожным в ближайшие три месяца.

И ещё один шокирующий, но важный вывод. Мы привыкли думать, что главная угроза для ребёнка — незнакомец, например, педофил из чата. Но исследование говорит об обратном.

Чаще всего нежелательный сексуальный контакт в интернете исходил от знакомых людей: родственников, сверстников или друзей.

"Всё, что происходит в сети, находит своё отражение в реальной жизни. Потерял деньги в сети — ухудшилось материальное положение. Стал жертвой цифрового насилия — последствия могут быть крайне тяжёлыми, вплоть до суицида. Эта проблема актуальна для всех, но особенно — для несовершеннолетних. Дети более чувствительны, у них ещё нет достаточного уровня критического мышления и правовой грамотности", — отмечает Азиза Шужеева.

Отдельно она выделяет явление под названием "сексуальная эксплуатация детей" — это относительно новая форма цифрового насилия, при которой детей вовлекают в создание и распространение интимных материалов, шантажируют ими или используют онлайн-платформы для насилия и извлечения выгоды.

Роль ИИ в сексуальной эксплуатации детей

Всё описанное выше — это риски, которые существовали и до эпохи генеративного искусственного интеллекта, но теперь к ним добавился новый уровень, который меняет природу угрозы принципиально.

Именно столько времени занимает процесс, который специалисты называют LoRA — тонкая настройка нейросети на конкретного человека. Злоумышленник берёт двадцать фотографий ребёнка из открытых источников, загружает их в модель — и получает инструмент, способный генерировать реалистичные видео с этим конкретным ребёнком в любом контексте, включая сексуализированный.

"Все, что мы сегодня пытаемся применить для бизнеса и проектов, ещё быстрее и в гипертрофированном виде используется мошенниками и людьми с преступным умыслом. Сегодня с помощью алгоритмов генерируются фейки, в том числе видео с изображениями конкретных детей в сексуальных форматах. Это серьёзная проблема. Исследований о том, как это влияет на психику ребёнка и его будущее развитие, практически нет", — отмечает Шужеева.

Разумеется, если есть противоправный контент, есть и борцы с ним. Например, британская организация Internet Watch Foundation (IWF) занимается мониторингом и удалением такого в интернете уже тридцать лет. В июле 2025 года она опубликовала данные, которые сложно уложить в голове.

По итогам всего 2025-го цифра выросла до 3 440 роликов против 13 в 2024-м.

IWF назвал прошедший год худшим за всю 30-летнюю историю своей организации. Причём материалы обнаруживались как в даркнете, так и на обычных коммерческих платформах в открытой сети.

Из всех подтверждённых видео 65 процентов были классифицированы как категория A — наиболее тяжёлая по британскому законодательству — они изображали изнасилования, сексуальные пытки и зоофилию.

И были настолько реалистичны, что по закону должны рассматриваться как запись реального преступления над живым ребёнком.

Отдельно IWF обнаружил подобный контент прямо на платформах чат-ботов. Внешне это выглядит как обычные легальные сервисы для взрослых. Но после обращений пользователей аналитики обнаружили скрытые разделы с преступным материалом. Метаданные сохранённых изображений содержали текстовые запросы, по которым они создавались — и намерения там были очевидны.

А в исследовании "Искусственный интеллект и сексуальная эксплуатация и насилие над детьми" говорится, что ЮНИСЕФ, ECPAT (неправительственная организация по борьбе с сексуальной эксплуатацией детей — прим. редакции) и Интерпол в рамках проекта "Disrupting Harm" выявили следующее:

в 11 странах не менее 1,2 миллиона детей сообщили о том, что за последний год их изображения были подвергнуты манипуляциям с помощью инструментов ИИ для создания откровенных сексуальных дипфейков. В некоторых странах этот показатель достигает одного ребёнка из 25, что эквивалентно одному ученику в типичном школьном классе.

Масштаб проблемы: мировая статистика цифрового насилия над подростками

Масштабы проблемы беспокоят правозащитников по всему миру. Например, всего за месяц Фонд наблюдения за интернетом Великобритании обнаружил почти 14 000 изображений, предположительно сгенерированных ИИ, с сексуальным насилием над детьми.

Помимо контента, создаваемого взрослыми правонарушителями, есть и тот, генерацией которого занимаются подростки. Причём жертвами непропорционально часто становились девочки.

Так, в Корее правоохранительные органы сообщили о десятикратном увеличении количества преступлений на сексуальной почве с использованием ИИ и технологий "дипфейк" в период с 2022 по 2024 год. Большинство обвиняемых по этим делам — подростки.

"Сегодня подростки гораздо более продвинуты в технологиях и многим из них не составляет труда сформулировать соответствующие промпты (задания — прим. редакции) для ИИ. При этом очень важно прививать подрастающему поколению понимание правил безопасного поведения в сети — среди контента, загружаемого в нейросети, не должно быть личных фотографий, тем более таких, которые могли бы навредить репутации", — отмечает Андрей Сиденко, руководитель направления по детской онлайн-безопасности "Лаборатории Касперского".

А в США опрос, проведённый организацией Thorn, показал: 1 из 10 подростков знает о случаях, когда его друзья или одноклассники создавали интимные изображения других детей без их согласия, используя генеративный ИИ.

Исследование ЮНИСЕФ также подтверждает, что дети сами хорошо осведомлены об этой угрозе: в некоторых из 11 стран, включённых в опрос, до двух третей респондентов выразили обеспокоенность тем, что ИИ может быть использован для создания поддельных изображений сексуального характера.

Как ИИ научили генерировать порнографию

Здесь важно понимать одну вещь, которую легко упустить. Часть ИИ-моделей обучалась не на случайных данных, а на реальных фотографиях и видео с насилием над конкретными детьми.

Есть и более широкая проблема. В исследовании "Guidance on AI and children" от ЮНИСЕФ приводится информация, которую установила Стэнфордская интернет-обсерватория в 2023 году:

датасеты или наборы данных, на которых обучались некоторые публичные модели генерации изображений, содержали материалы сексуального насилия над детьми. Они попали туда при автоматическом массовом сборе информации из интернета. Никто не проверял каждый файл вручную.

В результате материалы с реальным насилием над детьми стали частью обучающей базы совершенно "мирных" нейросетей.

Более того, существует и ещё один уровень проблемы, о котором почти не говорят.

Чтобы нейросети умели выявлять и блокировать запрещённый контент, их нужно обучить на примерах. А значит, кто-то должен просматривать огромные массивы такого материала вручную и помечать его маркерами "это насилие над ребёнком", "это допустимо", "это нужно удалить" и так далее.

Компании-разработчики часто отдают такую маркировку на аутсорс в страны третьего мира — за небольшие деньги, через онлайн-платформы. Так, издание Wired в 2023 году установило, что среди таких разметчиков данных есть несовершеннолетние. Они регистрируются на платформах, не указывая реальный возраст, и смотрят на контент, который разрушает психику даже взрослых.

Рост этой технологии породил неожиданную юридическую проблему. Подозреваемые в создании подобного контента всё чаще используют следующую тактику: когда следствие предъявляет им реальные записи насилия над живым ребёнком, они заявляют, что это не настоящая съёмка, а ИИ-генерация.

Помимо этого, производство такого контента размылось по цепочке.

- Создатель модели ИИ — одно лицо.

- Тот, кто её дообучил на конкретном ребёнке — другое.

- Тот, кто использовал готовую модель — третье.

- Платформа, где контент распространялся — четвёртый участник процесса.

Законодательство большинства стран пока не умеет работать с настолько распределёнными схемами преступности.

"Здесь нужно отметить одну важную вещь: сам по себе ИИ и создание дипфейков — это нейтральные технологии, не плохие и не хорошие. Важнее то, как их используют люди. Злоумышленники нередко применяют их для создания убедительных приманок. Например, чтобы втереться в доверие к пользователю, в том числе к ребёнку, узнать необходимую для злонамеренных действий информацию", — отмечает Сиденко.

Мировой опыт борьбы: как другие страны наказывают за ИИ-преступления

К сожалению, отмечает Азиза Шужеева, ни одна страна сегодня не может считаться образцом в контроле этой сферы. Правовая система насчитывает тысячелетия — от Древнего Рима до современных кодексов, но цифровое пространство появилось относительно недавно и его регулирование идёт по наитию.

"Если в реальной жизни уровень правового регулирования безопасности достаточно высок, то сейчас все преступления переместились в интернет: мошенничество, кибербуллинг, преследование, фейки, кража персональных данных. И эта сфера практически нигде ещё нормально не отражена в законодательстве. Поэтому сейчас мы находимся в точке, когда спасение утопающих, грубо говоря, в руках самих утопающих", — говорит она.

Нельзя сказать, что государства совсем никак не реагируют на новую проблему. Шужеева приводит в пример США, которые долгое время придерживались позиции, что технологические платформы не несут ответственности за контент, который распространяют пользователи их площадок.

Но эта позиция рухнула после прихода к власти Трампа. Буквально в течение месяца был принят закон Take It Down, который продвигала Мелания Трамп. Он ввёл уголовную ответственность за распространение материалов с несовершеннолетними, в том числе ИИ-сгенерированных.

Параллельно в Штатах шли судебные разбирательства с Meta, в ходе которых Марк Цукерберг признал: алгоритмы компании формировали информационный пузырь таким образом, что это наносило психологический вред подросткам.

"Это тоже прецедент — один из крупнейших технологических гигантов официально признал, что его алгоритмы причиняют вред детям", — отмечает Шужеева.

По данным же IWF, в Великобритании был введён новый состав преступления: создание, хранение или распространение инструментов, предназначенных для генерации материалов сексуального насилия над детьми.

Однако аналитики признают прямо: технология развивается быстрее, чем законодательство успевает на неё реагировать.

ЮНИСЕФ в рамках борьбы с распространением такого контента в 2025 году выпустил уже третью версию подробного руководства по ИИ и правам детей. Всё из-за того, что генеративные модели развиваются с огромной скоростью и пользуется ими всё большее количество людей.

65 тысяч жалоб: реальный уровень цифровой угрозы для детей в Казахстане

Несмотря на то, что эта проблема относительно новая для всего мира, кое-какая статистика по Казахстану в открытом доступе уже есть.

Организация Global Platform for Child Exploitation Policy регулярно собирает со всего мира репорты и жалобы от интернет-провайдеров и мобильных операторов для фиксации распространения контента, связанного с потенциальной сексуальной эксплуатацией детей. Есть там данные и по нашей стране.

Так, за первую половину 2025 года организация получила 65 тысяч таких репортов. Но здесь важно понимать — не все они связаны с распространением порнографии. Как отмечают казахстанские специалисты, система может отнести к этой категории фото или видео, к примеру, с сундет-тоя, поскольку на них могут быть обнажённые дети. Так что это немного плавающие данные, однако есть среди них и реальные противоправные кейсы.

Вот как аналитики классифицировали эти репорты:

Откуда берутся эти репорты? В основном — от казахстанских операторов. Tele2 предоставил 24 тысячи репортов, "Казахтелеком" — 18 тысяч, Mobile Telecom-Service — 9 500. Более того, аналитики разделяют контент и по площадкам.

Данные предоставляются NCMEC (американский Национальный центр по делам пропавших и эксплуатируемых детей) представителям федеральных правоохранительных органов США. По Казахстану ни одно государственное ведомство официально не назначено получателем этих данных.

Другими словами, американская система фиксирует тысячи случаев с участием казахстанских детей, а казахстанские ведомства эти данные системно не получают. Это не чья-то вина. Это пробел в архитектуре международного взаимодействия, который никто пока не закрыл.

Как работают казахстанские правоохранители

Мы отправили запрос в Министерство внутренних дел Казахстана с вопросами об использовании ИИ для создания контента с сексуальным насилием над детьми и о том, как наше законодательство регулирует эту сферу.

В МВД ответили, что департамент по противодействию киберпреступности проводит мониторинг интернет-пространства, социальных сетей и мессенджеров, анализирует тенденции в сфере киберпреступности и взаимодействует с международными партнёрами.

По их информации, с начала 2025 года через систему "Кибернадзор" в Министерство культуры и информации направлено 2 766 материалов порнографического содержания для блокировки.

Также в ведомстве добавили, что ответственность за изготовление, хранение и распространение порнографических материалов, в том числе с участием несовершеннолетних, предусмотрена статьёй 311 Уголовного кодекса. При этом отдельно подчёркивается:

"Использование современных цифровых технологий, включая инструменты искусственного интеллекта, при создании противоправного контента не освобождает виновных лиц от установленной законом ответственности".

Это важная формулировка.

Она означает, что, даже если ролик сгенерирован нейросетью, а не снят на камеру, по казахстанскому законодательству это всё равно преступление. Принцип действует. Но следующий вопрос — о правоприменении.

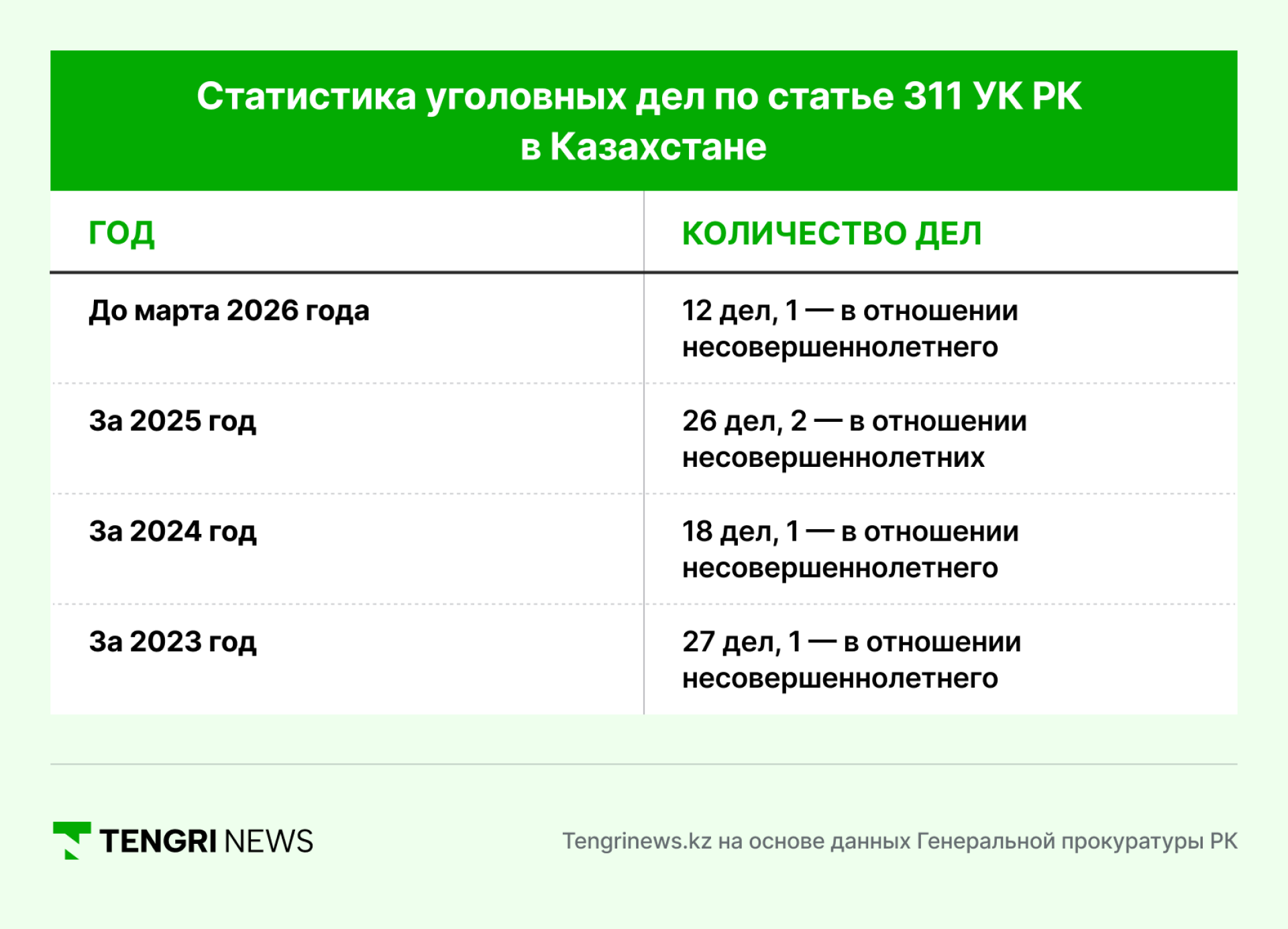

Теперь посмотрим на статистику уголовных дел по соответствующей статье:

Соотнесём цифры: 65 тысяч репортов за полгода из Казахстана — 26 уголовных дел за весь 2025 год. Это не означает, что правоохранители плохо работают. Это означает, что возможности системы реагирования несоразмерны масштабу явления.

Огромная часть того, что фиксируется как преступная онлайн-деятельность, либо не доходит до следствия, либо не квалифицируется по этой статье, либо остаётся вне поля зрения национальных органов.

Главный вопрос — что с этим делать

Самое очевидное решение, которое может прийти на ум как рядовым казахстанцам, так и власти: запретить, заблокировать, ограничить доступ к соответствующим технологиям.

Однако все эксперты, с кем мы говорим, сходятся во мнении, что это не выход и почти никак не решит проблему.

"Современные инструменты позволяют блокировку обходить при желании — люди просто переходят на другие хостинги. Мы не можем физически отключиться от цифрового мира — он даёт слишком много возможностей: образование, качественный контент, заработок, коммуникация. Поэтому нужно учиться с ним жить. Нужно массовое обучение, развитие алгоритмов блокировки противоправного контента, усиление взаимодействия с платформами, ужесточение цифрового законодательства и развитие киберполиции — с конкретными механизмами и быстрыми алгоритмами решения проблем", — отмечает Шужеева.

В этом и заключается весь вывод.

Вот для чего ЮНИСЕФ, IWF, Стэнфордский университет и прочие мировые организации так активно изучают эту неприятную и местами жуткую тему — чтобы затем научить пользователей "цифровой гигиене" и защите своих персональных данных.

Тут Шужеева приводит в пример Эстонию, где основы цифровой грамотности начали вводить уже в детском саду. Она убеждена: чем раньше и мы начнём такое обучение, тем лучше: с каждым годом возраст вхождения в интернет снижается.

"Если ребёнок по статистике уже в четыре-пять лет имеет доступ в интернет, он должен знать, как с этим работать. Мы же с малых лет объясняем, что нельзя трогать горячее или лезть в розетку. Это встроено в воспитание. С цифровым миром должно быть так же. В Казахстане принята концепция "Дети Казахстана" на 2026–2030 годы, где есть раздел о безопасности детей. Но любая концепция и любой конституционный вектор — это только направление. Дальше нужен механизм и реализация. И это зависит от того, насколько серьёзно государство возьмётся за выстраивание механизма", — отмечает она.

Сиденко придерживается похожего мнения и проводит простые аналогии: чтобы обезопасить себя на автотрассах, мы должны знать правила дорожного движения. Так и в digital-среде:

"В первую очередь детям и подросткам, как и другим пользователям интернета, важно знать, какую информацию можно публиковать, а какую — не стоит, к каким последствиям это приведёт, какими методами пользуются злоумышленники. Процесс такого просвещения многоступенчатый, помочь могут и школы, и ИТ- и ИБ-компании".

Параллельно эксперты указывают и на ответственность телекоммуникационных операторов. В Казахстане они считают себя "только провайдерами" — дали интернет, а что дальше происходит, "не наше дело".

В России, для сравнения, операторы обязаны по умолчанию бесплатно встраивать функцию родительского контроля во все базовые пакеты. В Казахстане это продаётся как дополнительная услуга.

Сиденко также указывает на необходимость родительского контроля:

"Большинство проблем, связанных с необходимостью ограничивать доступ к контенту, лежат в плоскости воспитания внутри семьи, той культуры, которая принята между родителями и детьми в отношении взаимодействия в digital-пространстве. Поэтому и большинство задач решается программами родительского контроля, которые могут создать безопасную среду для ребёнка в сети. В этом случае родители сами могут решать, какие сервисы, приложения и ресурсы в интернете оставлять, а какие блокировать".

Что касается самих платформ — их позиция "мы не отвечаем за контент" рухнула. Это произошло не потому что их создатели одумались, а потому что крупнейшие рынки — США и Европа — создали регуляторное давление.

Казахстан как отдельный рынок для таких компаний невелик. Но наш законодатель вполне может требовать от платформ соблюдения местных стандартов — в качестве условия для работы в стране.

Азиза Шужеева отмечает, что есть реальные инструменты борьбы. Метод хеширования — сравнение отпечатков файлов с базами данных известного противоправного контента. Метод детекции — когда алгоритмы ИИ сами анализируют изображения на наличие признаков и возрастных маркеров. Платформы могут встраивать эту опцию в свой функционал, блокируя подобный контент ещё на этапе загрузки. Технологии существуют. Вопрос — в политической воле и обязательных требованиях.

"Нужно, чтобы платформы несли ответственность. Далее нужно усиливать цифровое законодательство. И развивать киберполицию — с конкретными механизмами и быстрыми алгоритмами решения проблем. Более того, есть вопросы и к самим разработчикам — необходимо закладывать алгоритмы, которые делают невозможной генерацию такого контента изначально", — добавляет Шужеева.

Эксперты также предполагают, что государству нужно выставить свой этический кодекс, которому должны следовать разработчики ИИ. Если ваш алгоритм соответствует — работайте. Если нет — блокировка.

Параллельно Казахстан в прошлом году принял закон об искусственном интеллекте, согласно которому весь сгенерированный контент должен маркироваться. Это шаг.

Но реализация — как эта маркировка будет проверяться, кем, с какими последствиями за нарушение — пока остаётся без ответа. Готовятся и поправки в Конституцию — в статью 21, добавляющую защиту персональных данных и запрет на распространение сведений о частной жизни, в том числе с применением цифровых технологий.

"Конституция даёт вектор. Но дальше — механизм. А механизм требует институтов, бюджетов, специалистов и — главное — понимания, что именно нужно регулировать. Технология меняется быстрее, чем законодательный процесс", — считает Шужеева.

ЮНИСЕФ прямо говорит: то, что раньше было исключением — внимание к правам детей в ИИ-политике — должно стать нормой. Пока этого не произошло нигде. Но это не аргумент в пользу бездействия. Это аргумент в пользу того, чтобы начать — сейчас, не дожидаясь, пока статистика станет ещё хуже.

"Мы всё ещё учим детей не разговаривать с незнакомцами. Это правильно. Но незнакомец теперь не стоит у школьных ворот. Он — в алгоритме рекомендаций, в чат-боте, который притворяется другом, в приложении, которое обещает сделать фото смешнее. И у него — инструменты, которых не было ни у кого из предыдущих поколений", — заключает Шужеева.

Нужно учить детей новому и самим учиться.